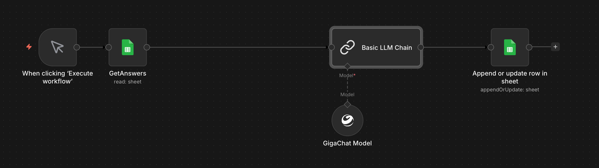

Как утром писал в своем уютном канале — занимался прокачкой воркфлоу n8n.

Решал задачу анализа и тегирования отзывов клиентов.

С одной стороны это вполне учебная задача, которые разбирают почти в любом курсе по n8n.

Но что будет если отзывов… например 100 000 ?

Нода Basic LLM Chain — рискует не переварить весь объем данных, сломаться. Токены могут кончиться, соединение разорваться. Что сделаем?

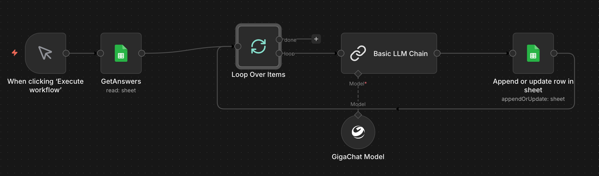

Поделюсь лайфхаком:

Порежем выдачу и будем передавать в LLM по частям. Добавляем ноду Loop Over Items с единственным параметром — по сколько элементов передавать (я выбрал 50)

Получается что обработав каждые 50 отзывов, воркфлоу запишет их в таблицу и возьмет следующие 50.

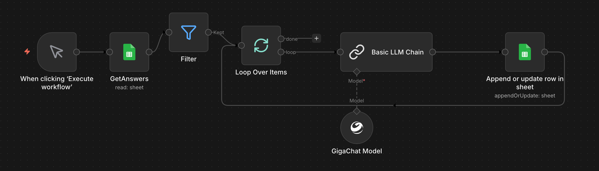

Как быть если и тут будет сбой? Как не перезапускать работу с самого начала?

Добавлю фильтр — и воркфлоу будет анализировать только те строки в файле, где еще нет значения. Таким образом можно не бояться сбоя, можно остановить воркфлоу в любой момент и продолжить с того места, где работа остановилась.

Получается простенько, но задачу выполняет сильно лучше и без перерасхода токенов.